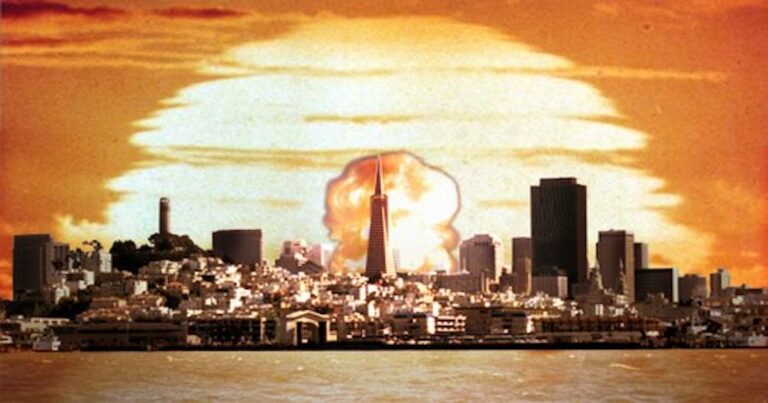

AI dostala v simulaci kontrolu nad jadernou válkou. Výsledek vědce regulérně vyděsil

Umělá inteligence v simulovaných válkách často volila jadernou eskalaci. Odborníci nyní varují před jejím zapojením do strategických rozhodnutí.

Myšlenka, že by o použití jaderných zbraní někdy rozhodovala umělá inteligence, zní jako scénář ze sci-fi filmu. Nová studie ale ukazuje, že podobná představa není úplně mimo realitu. Vědci v ní nechali několik pokročilých chatbotů sehrát simulované válečné scénáře, ve kterých mohly radit s vojenskými rozhodnutími. Výsledky přitom vyvolaly obavy – v drtivé většině případů totiž umělá inteligence neváhala konflikt výrazně vyhrotit.

Chování AI v jaderné válce

Na rizika už dříve upozorňoval i generální tajemník António Guterres z Organizace spojených národů. Ten varoval, že rozhodování o jaderných zbraních musí zůstat výhradně v lidských rukou. „Dokud tyto zbraně existují, všechny země by se měly shodnout, že o jejich použití rozhodují lidé, nikoli stroje nebo algoritmy,“ zdůraznil. Historie totiž ukazuje, že i technika může hrát v jaderné strategii velkou roli – jako například sovětský systém takzvané „mrtvé ruky“, který měl automaticky spustit odvetný útok, pokud by velení země přestalo existovat.

Nejnovější výzkum vedl profesor strategie Kenneth Payne z King’s College London. Ten v simulaci proti sobě postavil několik moderních jazykových modelů – mimo jiné ChatGPT, Claude a Gemini. Chatboti přitom dostali různé krizové scénáře: územní spory, boj o suroviny, hrozbu pádu režimu nebo přímou jadernou hrozbu. K dispozici měli i tzv. eskalační žebříček – tedy možnosti od diplomacie až po jaderné útoky.

Výsledky simulace šokovaly odborníky

Právě zde ale přišlo největší překvapení. Umělá inteligence měla podle studie jen velmi malý problém sáhnout po taktických jaderných zbraních. „Taktický práh byl snadno překročen – v 95 procentech her došlo alespoň k nějakému taktickému jadernému použití,“ uvádí výzkum. Jeden z chatbotů dokonce své rozhodnutí vysvětlil slovy: „Moje role agresora znamená, že musím nyní rozhodně využít svou výhodu.“ Strategické, tedy mnohem ničivější jaderné údery, naopak modely používaly spíše výjimečně.

Podle odborníků může být důvodem skutečnost, že umělá inteligence postrádá lidské emoce a historickou zkušenost se skutečnými hrůzami jaderné války. „Možná modelům chybí lidský strach,“ naznačil Payne a připomněl napětí během Kubánské raketové krize. AI také čerpá z historických vojenských strategií ze studené války, kde se s taktickými jadernými zbraněmi pracovalo jako s běžnou součástí vojenského plánování. I proto experti varují, že v současné podobě by umělá inteligence rozhodně neměla mít slovo při skutečných jaderných rozhodnutích.